Guide d'exposition

Textes de salles

Le monde selon l'IA

Introduction

Introduite pour la première fois en 1955, l’expression « intelligence artificielle » (IA) désigne aujourd’hui des algorithmes et des modèles capables d’effectuer automatiquement des opérations – détection, reconnaissance, classification, prédiction, analyse et génération de données – aux innombrables applications. Depuis la fin des années 2000, ces algorithmes et ces modèles s’infiltrent dans toutes les strates de la culture et de la société, de l’économie et de la politique, de la science et des opérations militaires. Partout, leur usage soulève de multiples questions éthiques, épistémologiques, politiques et géopolitiques, d’autant qu’il nécessite de colossales ressources matérielles et environnementales.

Dans ce contexte, les images jouent un rôle crucial : l’impact de l’IA sur les pratiques artistiques contemporaines et sur la culture visuelle en général compte parmi les phénomènes les plus visibles dans un environnement pourtant hautement dominé par des opérations discrètes, des processus invisibles, des boîtes noires. Les technologies d’IA transforment en profondeur la manière dont les images sont prises, créées, modifiées, diffusées, décrites et vues.

Depuis les années 2010, de nombreux artistes interrogent l’influence grandissante de l’IA dans nos sociétés et explorent ces bouleversements au moyen de différents médiums.

L’exposition Le Monde selon l’IA présente une sélection d’œuvres créées entre 2016 et aujourd’hui, dont plusieurs inédites, qui posent la question de l’expérience du monde « selon l’IA » ou « au prisme de l’IA ». Soit, en d’autres termes, de ce que signifie percevoir, imaginer, connaître, se souvenir, travailler, agir dans un monde de plus en plus innervé par des technologies d’IA tendant à redéfinir l’identité et la place de l’« humain ».

Pensé spécialement pour les salles du Jeu de Paume, le parcours reflètent la distinction fondamentale entre « IA analytique » (dont font partie les systèmes de vision artificielle et de reconnaissance faciale) et « IA générative »*.

Des « capsules temporelles », conçues comme des cabinets de curiosités**, relient le présent au passé, en inscrivant les transformations en cours dans une perspective historique.

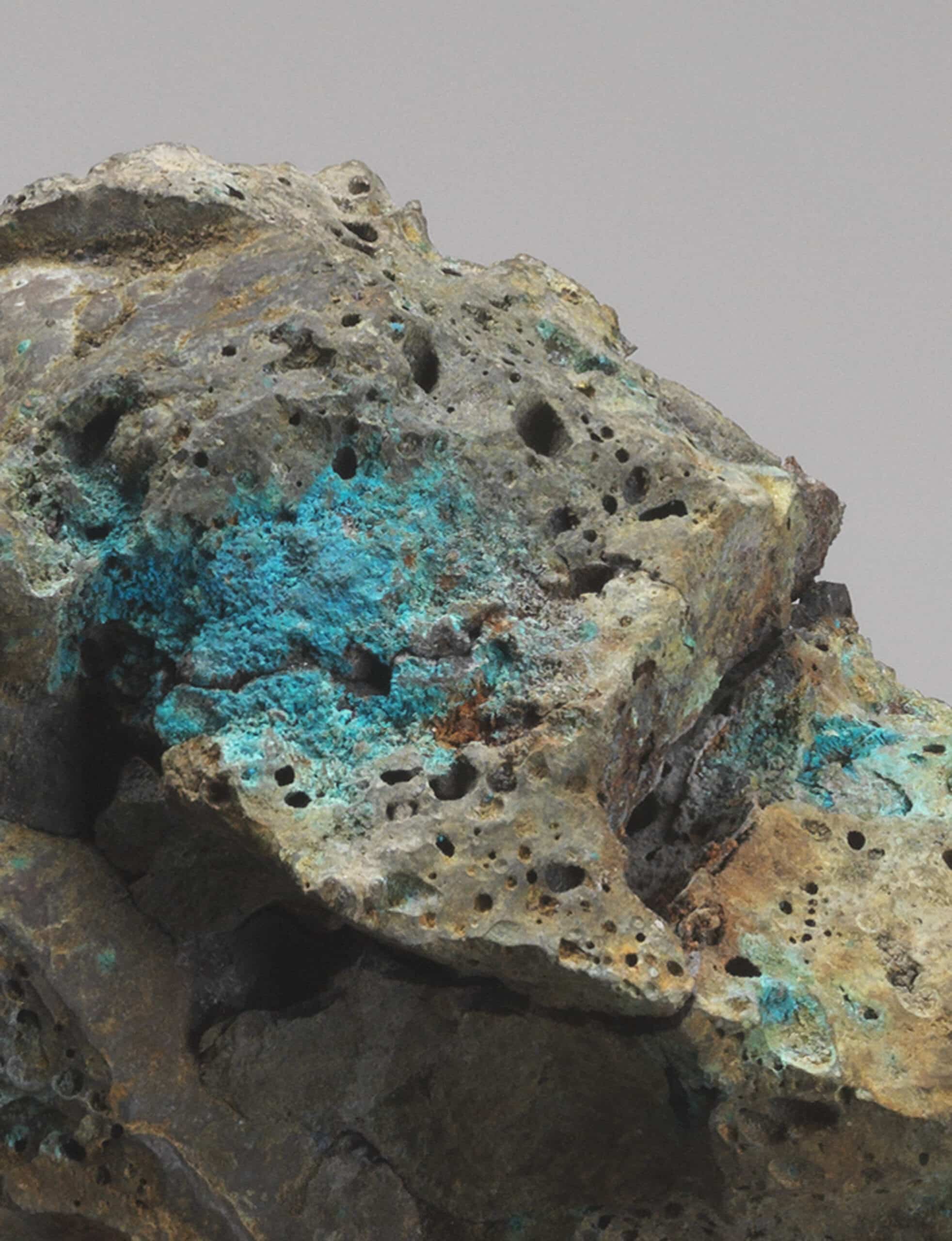

Matières

Les technologies numériques revêtent une dimension profondément matérielle et même géologique. Contrairement à une idée très répandue, et loin de toutes notion de « dématérialisation », les données ne sont pas stockées, gérées et traitées dans des clouds, des « nuages », mais dans des data centers dont le fonctionnement mobilise des quantités massives d’énergie et d’eau. Les calculs mis en œuvre pour entraîner et utiliser les modèles d’IA sont extrêmement énergivores, et poussent à présent les principales entreprises de la tech à se tourner vers le nucléaire. Sous sa forme actuelle, l’IA repose sur des industries extractives, l’exploitation d’énergies et de ressources non renouvelables : eau, terres rares, pétrole et charbon. Les œuvres de Julian Charrière et d’Agnieszka Kurant soulignent cet entrelacement profond entre l’artificiel et le naturel, du non-organique et de l’organique au cœur des technologies numériques et de l’IA.

Cartographies de l’IA. Espaces et temps

Qu’entend-on exactement par « IA » ? Comment cartographier cet « hyperobjet », dans lequel s’entrelacent de façon complexe théories et technologies, sources d’énergies et matières minérales, travail humain et données numériques, institutions et infrastructures, politiques étatiques, idéologies d’entreprise et capitaux financiers ? Et comment situer l’IA dans l’histoire, en tenant compte du rôle crucial qu’elle joue désormais dans la formation et l’articulation du savoir, de la communication, du travail et du pouvoir ? Les deux grands diagrammes de Kate Crawford et Vladan Joler – Anatomy of an AI System (2018) et Calculating Empires (2023) – tentent de relever le défi de proposer une cartographie critique de l’IA dans l’espace et dans le temps.

Automatisation, systématisation

L’IA, dans sa forme actuelle, est le produit d’une longue histoire enchevêtrée de tentatives d’automatiser le calcul, la production et la communication. Un tournant majeur est amorcé, au XIXe siècle, par Charles Babbage (1792-1871), qui inaugure l’ère de la programmation informatique en empruntant aux métiers à tisser leurs cartes perforées pour élaborer sa machine analytique, dont le code est conçu par Ada Lovelace (1815-1852).

L’IA répond par ailleurs aux rêves anciens de se doter de doubles – notamment des automates – auxquels déléguer des tâches et d’organiser le savoir de manière universelle

Intelligences collectives

L’IA peut être considérée comme l’expression d’une « intelligence collective », à la fois humaine et non humaine. Les modèles d’IA sont entraînés avec des jeux de données qui réunissent de vastes quantités de contenus produits par des humains. Des millions de « microtravailleurs » participent à l’entraînement des modèles et à la modération des contenus générés. Les modèles eux-mêmes reposent sur des algorithmes d’apprentissage profond, dont les processus mathématiques peuvent s’apparenter à une forme d’« intelligence » non humaine.

Interprétée selon cette perspective, l’IA présente une série d’analogies avec des formes d’« intelligence collective », dont les effets s’exercent à des échelles variant du microscopique jusqu’au planétaire. L’œuvre d’Agnieszka Kurant souligne notamment que l’« intelligence » émerge toujours d’une multiplicité d’agentivités : au sein des colonies de termites, des interconnexions entre les arbres, des murmures d’étourneaux, des mouvements sociaux humains, ou encore des réseaux de neurones artificiels – qui traitent des données humaines et non humaines. Clemens von Wedemeyer donne forme à ces réseaux dans les cyanotypes tirés de son installation vidéo Social Geometry (2024) composée de diagrammes permettant de visualiser les interactions sociales.

Vision artificielle

Les tentatives d’automatiser la perception visuelle remontent aux origines des recherches sur l’« intelligence artificielle » à la fin des années 1950. Après plusieurs phases d’accélération et de ralentissement, le développement des systèmes de vision artificielle est entré dans une nouvelle phase à partir du début des années 2010, au point qu’aujourd’hui ce « regard » non humain et algorithmique transforme l’iconosphère numérique – les milliards d’images stockées sur Internet et circulant sur une multitude de réseaux et de plateformes – en un gigantesque champ d’extraction et d’agrégation de données. Le « champ de vision » de ces systèmes – avec leurs points aveugles, leurs erreurs, leurs biais – dépend de plusieurs facteurs : modèles d’IA choisis, contenu et structure des jeux de données utilisés pour les entraîner, travail humain employé pour cet entraînement.

Depuis 2017, Trevor Paglen tente à travers ses œuvres et de ses écrits de comprendre les enjeux épistémologiques et politiques d’une culture visuelle nouvelle, où les images ne circulent plus seulement entre humains, mais aussi entre machines sans que des humains ne soient nécessairement dans la boucle.

Vision artificielle

Le développement de plus en plus rapide, depuis les années 2000, des systèmes de vision artificielle invite à revenir sur l’histoire de l’automatisation de la perception visuelle.

Les tentatives menées tout au long du XXe siècle suivent deux axes : d’une part, l’exploration du potentiel esthétique, épistémologique et politique de la caméra, appareil capable de décentrer ou remplacer le regard humain et de nous faire découvrir le monde visible sous un nouvel angle ; d’autre part, l’élaboration de systèmes qui automatisent la vision à des fins de contrôle et de surveillance.

Reconnaissance des visages et des émotions

Les technologies de reconnaissance des visages et des émotions occupent aujourd’hui une place prépondérante dans le domaine de la vision artificielle, soulevant des enjeux éthiques et politiques majeurs. Progressivement mises au point depuis les années 1960, elles s’inscrivent dans l’histoire longue de la physiognomonie, à savoir les tentatives de classer les individus par « types » et d’établir des liens systématiques entre les traits du visage et la personnalité, l’extériorité et l’intériorité.

Le début des années 2010 marque un tournant majeur pour ces technologies, avec l’utilisation de nouveaux modèles d’IA analytique et la possibilité de les entraîner au moyen de jeux de données (datasets) comme ImageNet (2009), ce dernier étant constitué à partir d’images photographiques massivement récupérées sur Internet et les réseaux sociaux – sans aucune autorisation de la part des personnes qui y étaient représentées. Ces images ont ensuite été étiquetées à la chaîne par des dizaines demilliers d’« ouvriers du clic », induisant dans les jeux de données nombre d’approximations, d’erreurs et de biais. Trevor Paglen et Adam Harvey analysent la genèse, les champs d’application et les enjeux épistémologiques et politiques de ces systèmes de plus en plus répandus à travers nos sociétés.

Reconnaissance des visages et des émotions

Les systèmes algorithmiques de reconnaissance des visages et des émotions s’inscrivent dans une longue histoire culturelle et technique de codification des traits du visage et de catégorisation des individus. Ils reprennent le postulat, problématique, d’une correspondance entre apparence, caractère et émotions, qui sous-tendait plusieurs pseudosciences populaires aux XVIIIe et XIXe siècles : physiognomonie, phrénologie, craniométrie. L’invention de la photographie exacerbe encore les velléités de fichage, instaurant des dispositifs de surveillance policière dont on retrouve des traces dans les modèles contemporains de reconnaissance faciale par IA.

Micro-travail

Depuis la fin des années 2000, une main-d’œuvre implantée pour la plupart dans le Sud global contribue sans relâche à l’entraînement et à la supervision des technologies d’IA. Recrutés et coordonnés par des plateformes de crowdsourcing comme Amazon Mechanical Turk, des millions de « travailleurs du clic » effectuent des tâches répétitives, telles que l’indexation d’images ou la modération des contenus générés par IA. Cet emploi, qui peut être psychologiquement éprouvant quand il s’agit de repérer et d’éliminer des images montrant des scènes de violence et d’abus, est rémunéré sur la base d’une grille variant selon les pays de résidence, et souvent dépourvu de cadre juridique et de protection sociale. L’installation de Hito Steyerl dénonce cette exploitation produite par les nouvelles formes du capitalisme numérique, tandis qu’Agnieszka Kurant cherche à dresser un portrait composite des invisibles du numérique. L’installation du collectif Meta Office, réalisée en collaboration avec ces travailleurs, dévoile la diversité de leurs lieux de travail et leur précarité, et présente une critique des lacunes éthiques et juridiques qui affectent cette classe ouvrière émergente.

IA GÉNÉRATIVE ET ESPACES LATENTS

L’expression « IA générative » renvoie à un large spectre de modèles d’IA capables de générer des données nouvelles (par exemple, des textes ou des images fixes ou en mouvement) après avoir été alimentés avec d’énormes quantités d’autres données. Durant leur entraînement, les modèles d’IA générative encodent et positionnent massivement des textes et des images collectés sur Internet dans ce que l’on appelle des « espaces latents », c’est -à-dire de gigantesques systèmes de vecteurs numériques représentant des points de données susceptibles d’être traités via diverses opérations mathématiques. Une fois que ces espaces latents sont construits, les utilisateurs peuvent les explorer au moyen de plusieurs techniques afin de modifier textes et images ou en générer de nouveaux. Ce processus complexe comprend une grande part de hasard et d’imprévisibilité.

Le développement du champ de l’IA générative, depuis le milieu des années 2010, a eu comme conséquence la diffusion dans la culture contemporaine de ces constructions mathématiques, abstraites et invisibles, que sont les « espaces latents ». Ces derniers étant de plus en plus utilisés pour l’encodage, la transformation et la transmission de la mémoire culturelle, plusieurs artistes contemporains se sont emparés du sujet. Certains explorent les espaces latents commercialisés par les principales entreprises de la tech, essayant d’en contourner les limites et les styles prédéfinis, ou encore d’en exploiter les dysfonctionnements, comme le fait Julien Prévieux dans l’installation Poem Poem Poem Poem Poem (2024-2025), qui court du rez-de-chaussée au premier étage de l’exposition. D’autres tentent de modifier les espaces latents existants pour y introduire de nouvelles entités, ou encore s’efforcent d’influencer les espaces latents du futur, voire de produire de nouveaux espaces latents, ouverts et collectifs, à l’instar de Holly Herndon et Mat Dryhurst dont une installation est présentée dans la mezzanine.

Art génératif

Dans les années 1960, peu après que les premiers modèles d’ordinateurs ont vu le jour, des artistes du monde entier expérimentent le codage à des fins plastiques et visuelles. Le recours aux algorithmes leur permet de poser un ensemble de règles et d’instructions à partir desquelles une œuvre peut être générée automatiquement.

Si ces réalisations se caractérisent surtout par l’abstraction ou la répétition sérielle, la figuration n’en est pas exclue.

Dans les espaces latents de l’histoire

Les modèles d’IA générative offrent aux artistes des moyens de de revisiter l’histoire de l’art et le patrimoine culturel. En effet, en entraînant des modèles d’IA sur des corpus spécifiques, on peut non seulement chercher à reconstituer des objets lacunaires, mais aussi susciter de nouveaux objets du passé, soit des objets qui auraient pu exister mais demeuraient dans un état de pure virtualité, tels les peintures rupestres créées par Justine Emard ou les fossiles et sculptures antiques d’Egor Kraft.

Élaborés par les IA génératives à partir des données compilées dans leurs espaces latents, ces artefacts troublants esquissent une histoire synthétique, alternative, délibérément contrefactuelle. Il en ressort une entreprise éminemment poétique et spéculative lorsqu’il s’agit de restaurer ou prolonger les gestes des artistes antiques, ainsi que leur imaginaire. Lorsqu’elle révèle et détourne les biais qui façonnent les discours historiographiques et les orientations des institutions patrimoniales, la démarche se fait critique. Apparaissent ainsi aux artistes de nouvelles stratégies et modalités de négociation avec le passé, de réflexion sur les héritages – selon une perspective souvent engagée et décoloniale –, comme l’illustrent les œuvres ici présentées de Nora Al-Badri, de Nouf Aljowaysir, ou encore de Theopisti Stylianou-Lambert et d’Alexia Achilleos. Dans son installation produite pour cette exposition, Jacques Perconte explore quant à lui les enjeux d’une autre opération rendue possible par l’IA, le upscaling, qui consiste à augmenter le degré de définition des images – non sans soulever de nombreuses questions relatives au champ de la restauration des images.

Ruines, archéologies imaginaires

Les avancées récentes de l’IA générative permettent non seulement de produire de nouvelles œuvres mais aussi de compléter et réinterpréter des œuvres lacunaires.

Sont ainsi relancés plusieurs gestes qui traversent l’histoire de l’art : tentatives de reconstituer, avec les ressources de l’imagination puis celles de l’archéologie, le patrimoine ancien qui nous est parvenu dans un état fragmentaire ; et méditation sur les ruines, objet de fascination universelle, propice à susciter fantaisie et caprices.

Mots et images

Les modèles de diffusion text-to-image et text-to-video permettent désormais de créer automatiquement, pour la première fois dans l’histoire, des images fixes ou en mouvement à partir de seules consignes écrites, les prompts. L’usage de ces prompts transforme radicalement l’exercice, classique en histoire de l’art, de la description d’images, l’ekphrasis, qui devient, dans ce cadre nouveau, opératoire : des images sont générées sur la base d’une description préalable. À l’inverse, les modèles image-to-text sont capables, à partir d’images fixes ou en mouvement, d’en générer une description textuelle détaillée, donnant lieu à une ekphrasis automatique.

S’instaure ainsi une imbrication algorithmique tout à fait inédite, entre les mots et les images, le dicible et le visible. Les différentes opérations de conversion algorithmique des premiers vers les secondes, et inversement, s’accompagnent d’inévitables décalages, approximations et erreurs qui ouvrent aux artistes toute une gamme d’expérimentations poétiques et visuelles, comme en témoigne l’installation du collectif Estampa.

Protohistoire des prompts

Les modèles de diffusion text-to-image nécessitent des prompts, c’est-à-dire des instructions textuelles fournies à l’IA pour générer des images. Cette pratique performative peut être considérée comme le prolongement de tout un pan de l’art conceptuel : les œuvres à protocole. À l’instar des images générées par des prompts, qu’il est indispensable de bien formuler, les œuvres à protocole reposent sur des instructions. Comme dans le cas des IA génératives, il est possible d’en déléguer l’exécution à un autre agent que l’artiste, induisant souvent une part d’aléatoire et de surprise. Avec les prompts, qui génèrent des images en les prédécrivant, ce sont aussi les liens entre les mots et les images qui sont remis en question.

Photoréalisme

Historiquement, l’IA et la photographie entretiennent une relation de réciprocité. D’une part, depuis les années 2000, d’énormes quantités d’images photographiques sont utilisées pour l’entraînement des modèles d’IA analytique et générative. D’autre part, l’IA transforme en profondeur le champ de la photographie à travers non seulement la présence croissante d’algorithmes dans les caméras de nos smartphones, mais aussi par la génération et la diffusion, dans tous les champs de la culture visuelle, d’images photoréalistes qui ne sont pourtant issues d’aucune forme de captation optique.

Plusieurs artistes contemporains explorent les formes et les enjeux de ce nouveau type de photoréalisme. Joan Fontcuberta y recourt pour poursuivre ses réflexions sur le statut de l’image photographique au-delà de la valeur documentaire qui lui est historiquement associée. Érik Bullot y trouve un médium pour sonder un « cinéma imaginaire » à partir des traces de projets inachevés et de concepts parcourant l’histoire de la littérature, des techniques et des médias, ainsi que des pratiques médiumniques et des recherches parapsychologiques.

Apprentissage, hallucinations, spéculations

Ce programme de films et de vidéos propose des œuvres réalisées avec différents modèles d’IA générative text-to-image, text-to-video, et parfois aussi text-to-sound, telle la bande-son entièrement générée par l’IA du Rêve d’Abel Gance (2024) d’Erik Bullot.

Issus de différents types de collaboration entre artistes et algorithmes, ces films témoignent de l’expérimentation avec la capacité hallucinatoire de l’IA, avec leur imagerie singulière et troublante, et instaurent de nouvelles formes de récits, d’histoires et de montage.

Dans des registres aussi variés que l’essai documentaire (The Oasis I Deserve [2024] d’Inès Sieulle), la science-fiction dystopique (Chroniques du Soleil noir [2023] de Gwenola Wagon) ou encore la satire psychédélique (RAPTURE [2024] d’Andrea Khôra), ces pièces ont en commun de brouiller temporalités et perceptions, d’hybrider point de vue humain et point de vue machinique, et d’interroger notre rapport, en tant qu’humains, aux IA.

Where is my (Deep) Mind ? (2019) de Julien Prévieux et Auto-extinction (2023) de John Menick mettent en scène l’apprentissage automatique des IA, avec humour pour le premier et montage ultrarapide pour le second, invitant le spectateur à adopter une posture critique vis-à-vis des idéologies véhiculées par l’industrie de la tech.

Écritures génératives

Cette salle et la suivante explorent les effets de l’IA analytique et générative sur les pratiques d’écriture, qu’il s’agisse de récit, de poésie ou de partition musicale, et questionnent leur potentiel artistique, leurs limites et leurs incidences tant esthétiques que philosophiques. Quel serait le langage propre de l’IA et qu’apporterait-il à la littérature ? Comment la création littéraire peut-elle se distinguer face aux textes censurés et stéréotypés que produisent les IA génératives commerciales ? En quoi l’interaction écrite avec un chatbot peut-elle procurer une impression de présence ?

Les œuvres de Nick Montfort, de David Jhave Johnston et de Sasha Stiles nous invitent à réfléchir aux différentes modalités de collaboration littéraire avec une IA. Les travaux d’aurèce vettier et Linda Dounia Rebeiz se proposent par ailleurs d’imaginer, avec l’aide de l’IA, de nouveaux alphabets et de nouvelles écritures. L’installation sonore de Jeff Guess, par un renversement des rôles entre l’humain et la machine, explore les images mentales que le texte peut produire dans un esprit humain, tandis que Christian Marclay propose au visiteur de coécrire et coexécuter une partition audiovisuelle avec un algorithme de détection sonore.

Les multiples questions soulevées par ces différentes réalisations sont d’autant plus riches que les IA s’inscrivent dans une tradition d’expérimentation formelle ancienne : le désir de générer des textes à l’infini n’a pas attendu ChatGPT, il parcourt l’histoire culturelle depuis les rêves de Jonathan Swift à ceux de l’Oulipo. Ainsi le sonnet L’alternance des choses humaines (1671) composé par Quirinus Kuhlmann, poète baroque allemand, de manière à proposer six milliards de combinaisons, ou les Cent mille milliards de poèmes (1961) de Raymond Queneau, par la marge de manœuvre qu’ils offrent au lecteur, devançaient-ils la réflexion de Roland Barthes, dans La Mort de l’auteur (1967), sur la nécessité de séparer une œuvre de son créateur.

Littérature générative

Les ouvrages créés, ou plutôt cocréés avec des IA génératives abondent désormais dans les librairies, qu’il s’agisse d’histoire contrefactuelle ou de bande dessinée, de poésie ou de roman, suscitant fascination autant que polémiques. Ils s’inscrivent dans le sillage des courants d’avant-garde tels que l’Oulipo et Fluxus, et de la littérature générative produite après la Seconde Guerre mondiale, à l’instar notamment des travaux de Jean Baudot (1929-2001) au Canada, Theo Lutz (1932-2010) et Otto Beckmann (1908-1997) en Allemagne, Jean-Pierre Balpe (né en 1942) et Philippe Bootz (né en 1957) en France.

ELIZA

Premier chatbot de l’histoire, ELIZA fut créé en 1966 par Joseph Weizenbaum (1923-2008) au Massachusetts Institute of Technology (MIT). Grâce à une méthode de correspondance et substitution, ELIZA imite une conversation en associant, via un script, des mots entrés par les utilisateurs à une liste de réponses scénarisées possibles. Sa version la plus connue est dotée du script DOCTOR, qui simule un psychothérapeute. Inquiet à l’idée que l’IA puisse se substituer à la raison humaine, Weizenbaum en tirera l’une des premières réflexions sur l’éthique des IA, exposée dans son essai Computer Power and Human Reason (1976).

Réadaptation et sa traduction en français : David Berry, Sarah Ciston, Anthony Hay, Mark Marino, Peter Millican, Arthur Schwarz, Jeff Shrager et Peggy Weil